반응형

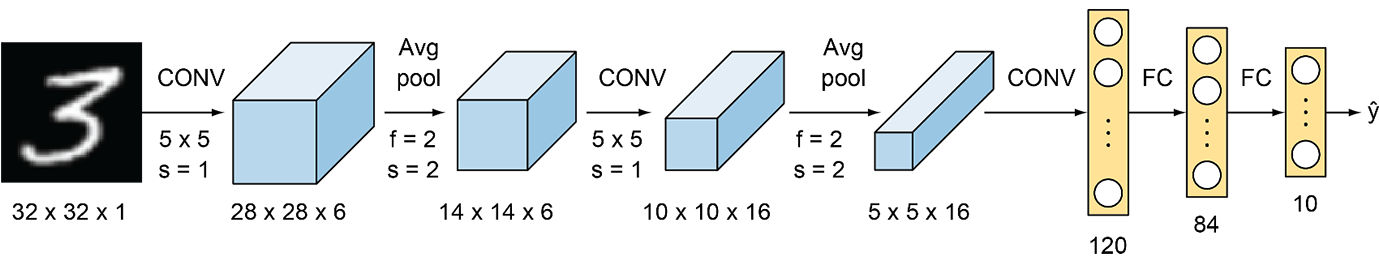

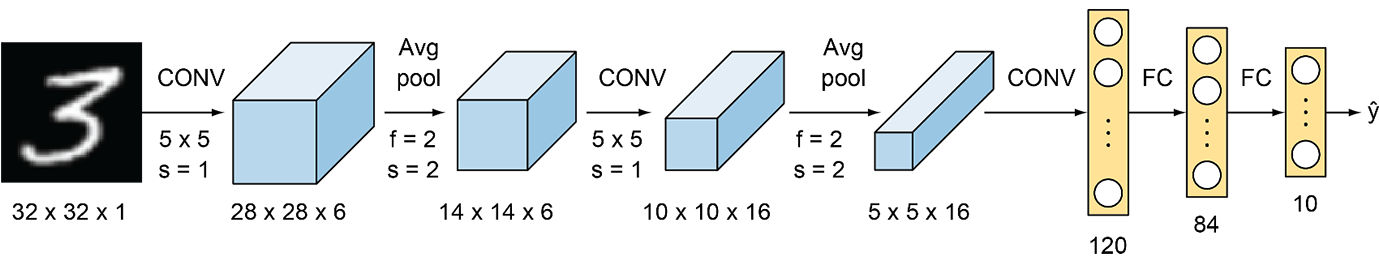

LeNet-5

- 앞에 작성한 Convlutional Nerual Network(CNN)을 최초로 제안한 논문인 Yann LeCun의 LeNet 입니다.

- LeNet-5은 손글씨 숫자를 인식하는네트워크입니다.

- LeNet-5는 Convolution layer와 Pooling layer을 반복하고 Fully Connected layer을 거쳐 결과를 출력합니다.

Convolution 연산의 동작 원리를 이해할 필요가 있습니다.

- 입력 데이터의 높이: height

- 입력 데이터의 너비: width

- 필터의 높이: filter_height

- 필터의 너비: filter_width

- 스트라이드(stride): stride

- 패딩 크기: padding

- Convolution 연산 이후의 출력 차원은 다음과 같은 공식으로 계산할 수 있습니다. (나누기할 때 소수점 아래 버림)

- 출력 높이(output height) = (height + 2 * padding - filter\_height) / stride + 1

- 출력 너비(output width) = (width + 2 * padding - filter\_width) / stride + 1

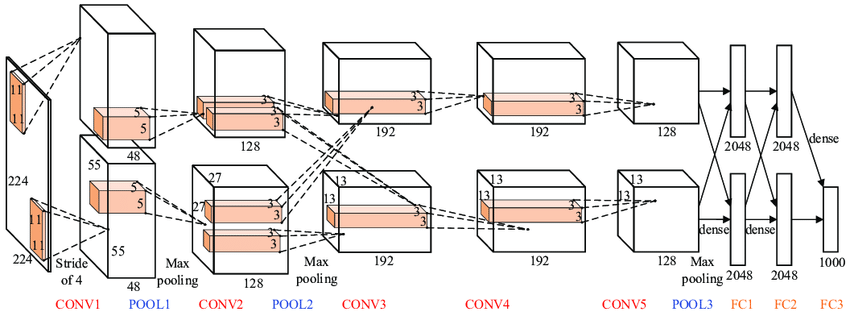

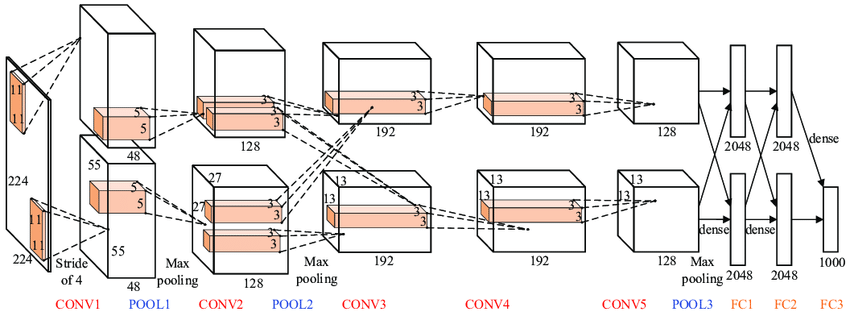

AlexNet

- AlexNet의 구조는 LeNet-5과 크게 다르지 않습니다. 위 아래로 filter들이 절반씩 나뉘어서 2개의 GPU로 병렬연산을 수행하는것이 가장 큰 특징입니다.

- 활성화 함수로 ReLU를 사용하는데, 기존까지는 sigmoid를 필두로 tanh이 사용되는 추세였는데, 알렉스넷이 ReLU를 사용결과 학습, 예측 속도가 훨씬 빠르고, 정확도는 유지되었다고 합니다.

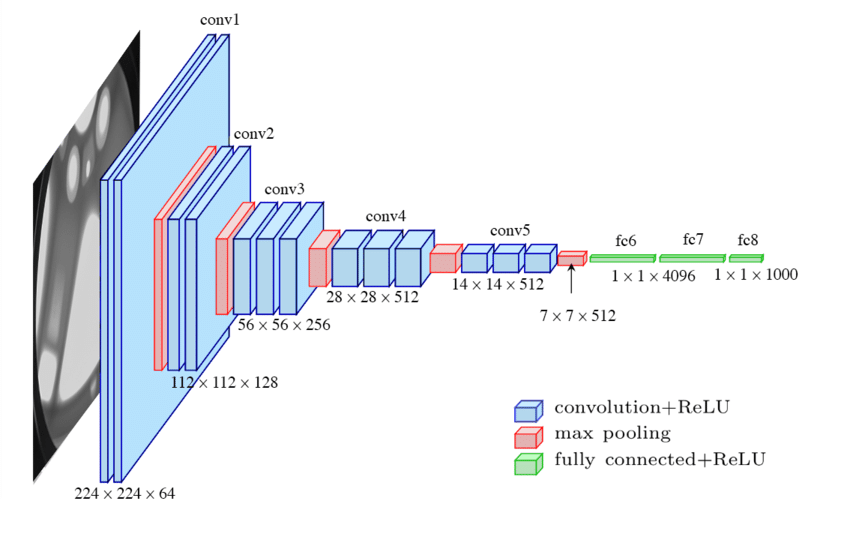

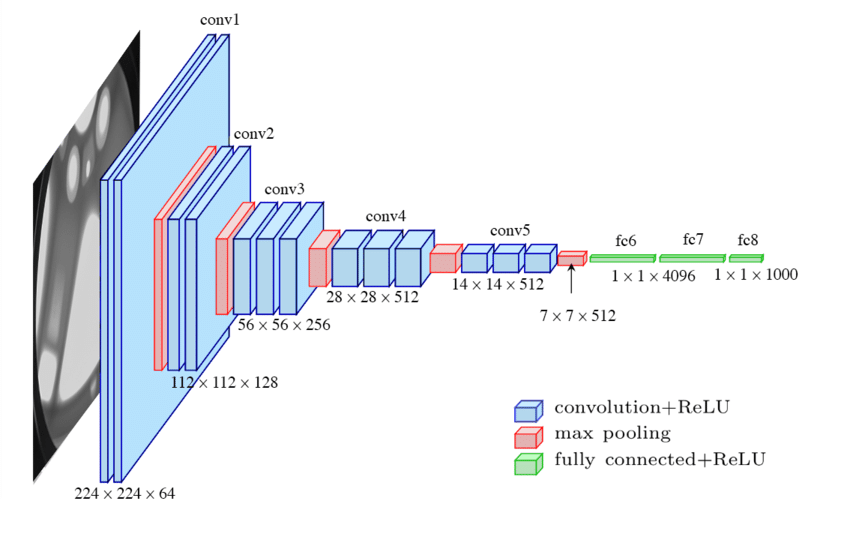

VCG-16-Net

- VCG는 이전 방식들과는 다르게 비교적 작은 크기인 3x3 convolution filter를 깊게 쌓는다는 것이 VGG의 핵심입니다.

- 3x3 convolutin filter를 통해 레이어의 깊이를 늘려 우수한 성능을 보입니다

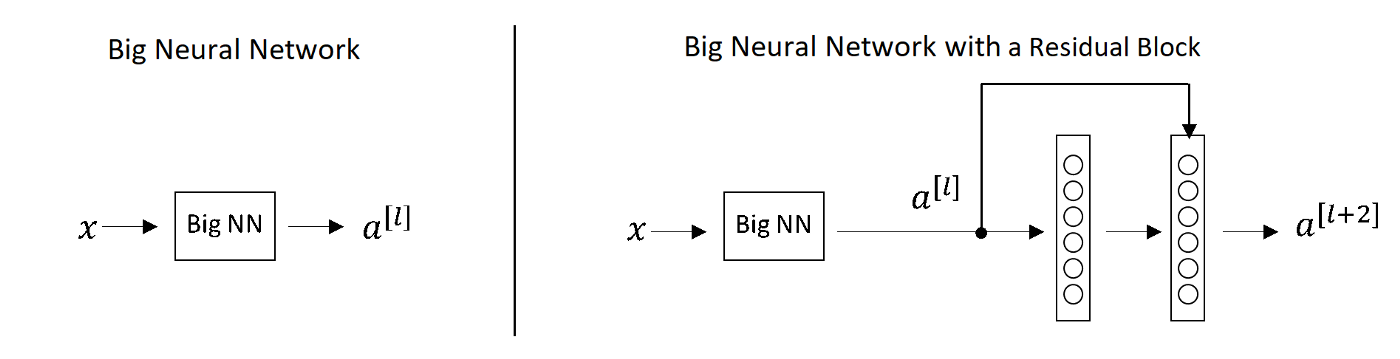

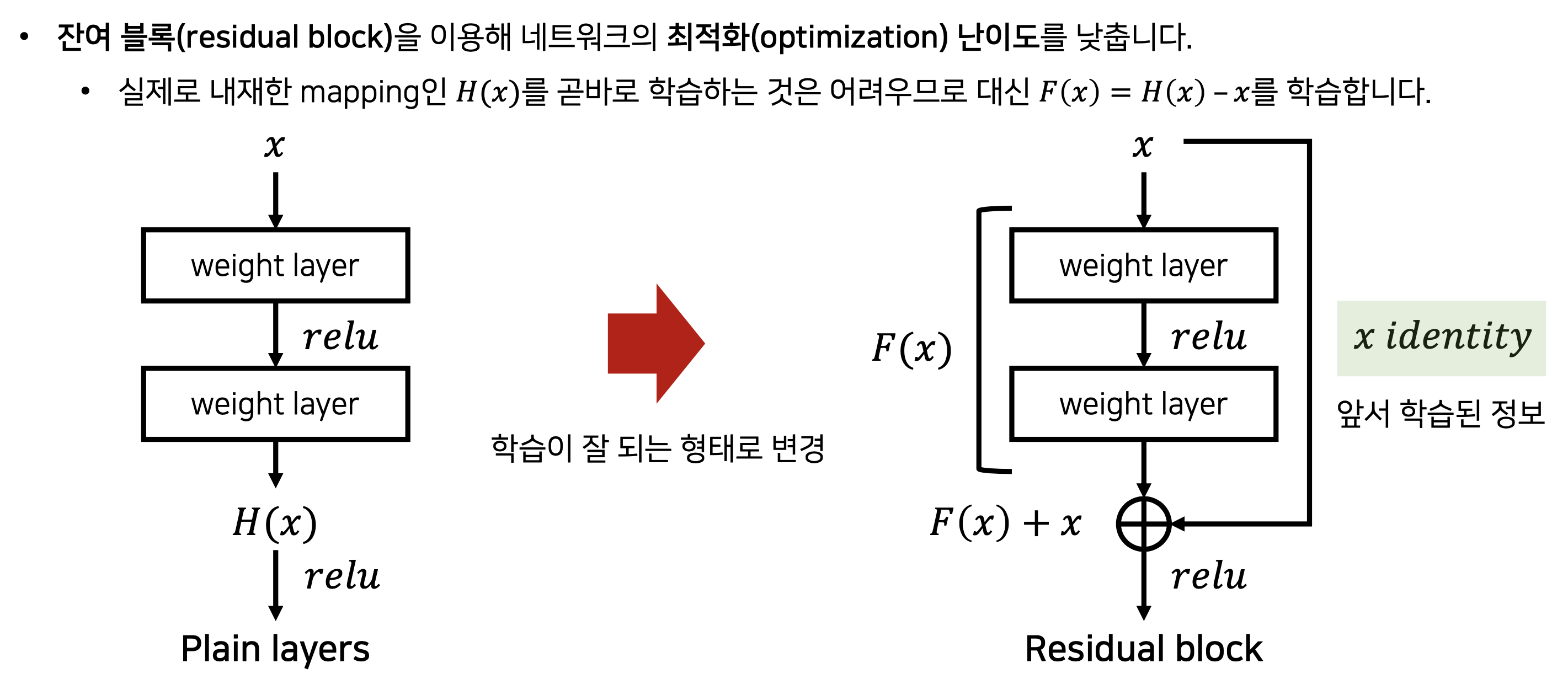

ResNet

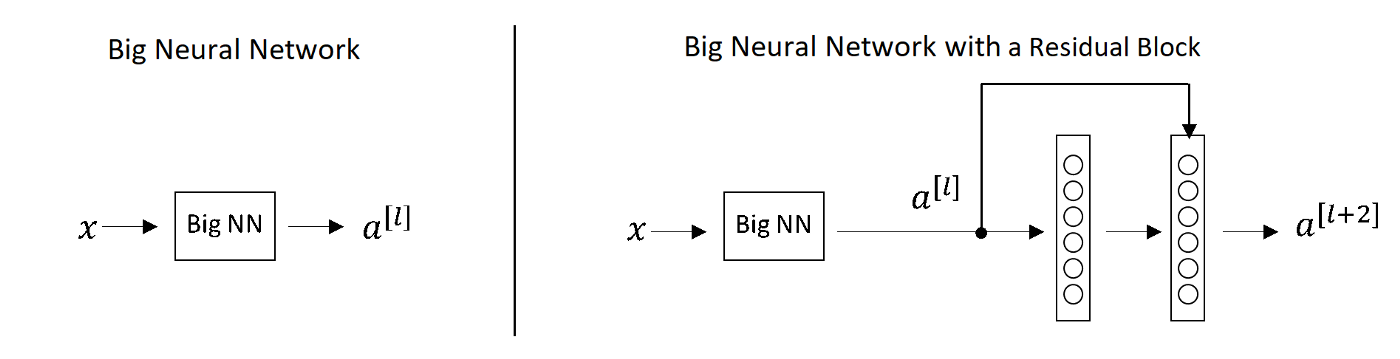

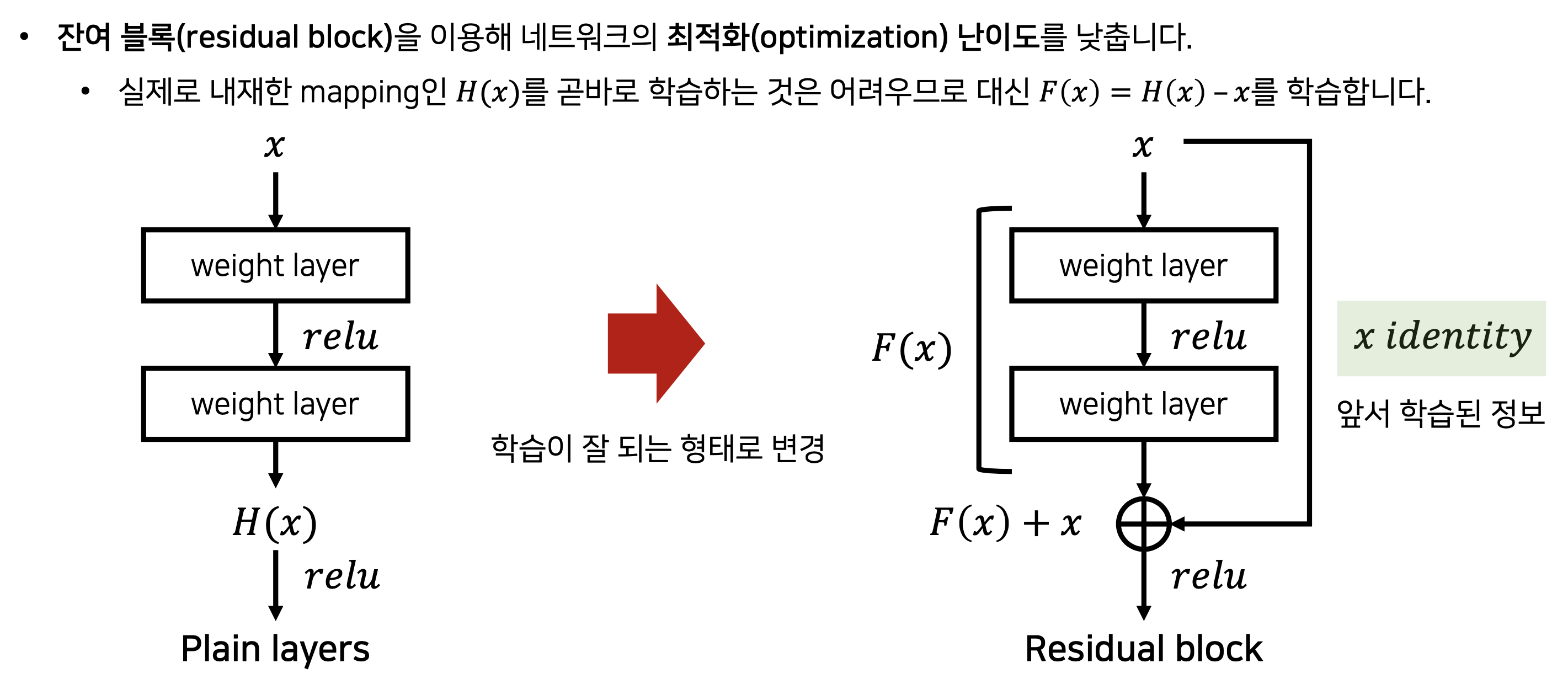

- ResNet은 기본적으로 VGG-19의 구조를 뼈대로 한다. 거기에 컨볼루션 층들을 추가해서 깊게 만든 후에, shortcut들을 추가하는 것이 사실상 전부다.

참고 링크

'AI_Bootcamp' 카테고리의 다른 글

| 6주차 Day22 Pix2Pix( CVPR 2017) (0) | 2022.02.10 |

|---|---|

| 6주차 Day21 GAN: Generative Adversarial Networks (0) | 2022.02.07 |

| 4주차 Day19 Deep Learning ANN,DNN,CNN 비교 (0) | 2022.02.01 |

| 4주차 Day18 로지스틱 회귀(Logistic Regression) (0) | 2022.01.27 |

| 4주차 Day17 Numpy 심화 실습 3 (0) | 2022.01.25 |

반응형

LeNet-5

- 앞에 작성한 Convlutional Nerual Network(CNN)을 최초로 제안한 논문인 Yann LeCun의 LeNet 입니다.

- LeNet-5은 손글씨 숫자를 인식하는네트워크입니다.

- LeNet-5는 Convolution layer와 Pooling layer을 반복하고 Fully Connected layer을 거쳐 결과를 출력합니다.

Convolution 연산의 동작 원리를 이해할 필요가 있습니다.

- 입력 데이터의 높이: height

- 입력 데이터의 너비: width

- 필터의 높이: filter_height

- 필터의 너비: filter_width

- 스트라이드(stride): stride

- 패딩 크기: padding

- Convolution 연산 이후의 출력 차원은 다음과 같은 공식으로 계산할 수 있습니다. (나누기할 때 소수점 아래 버림)

- 출력 높이(output height) = (height + 2 * padding - filter\_height) / stride + 1

- 출력 너비(output width) = (width + 2 * padding - filter\_width) / stride + 1

AlexNet

- AlexNet의 구조는 LeNet-5과 크게 다르지 않습니다. 위 아래로 filter들이 절반씩 나뉘어서 2개의 GPU로 병렬연산을 수행하는것이 가장 큰 특징입니다.

- 활성화 함수로 ReLU를 사용하는데, 기존까지는 sigmoid를 필두로 tanh이 사용되는 추세였는데, 알렉스넷이 ReLU를 사용결과 학습, 예측 속도가 훨씬 빠르고, 정확도는 유지되었다고 합니다.

VCG-16-Net

- VCG는 이전 방식들과는 다르게 비교적 작은 크기인 3x3 convolution filter를 깊게 쌓는다는 것이 VGG의 핵심입니다.

- 3x3 convolutin filter를 통해 레이어의 깊이를 늘려 우수한 성능을 보입니다

ResNet

- ResNet은 기본적으로 VGG-19의 구조를 뼈대로 한다. 거기에 컨볼루션 층들을 추가해서 깊게 만든 후에, shortcut들을 추가하는 것이 사실상 전부다.

참고 링크

'AI_Bootcamp' 카테고리의 다른 글

| 6주차 Day22 Pix2Pix( CVPR 2017) (0) | 2022.02.10 |

|---|---|

| 6주차 Day21 GAN: Generative Adversarial Networks (0) | 2022.02.07 |

| 4주차 Day19 Deep Learning ANN,DNN,CNN 비교 (0) | 2022.02.01 |

| 4주차 Day18 로지스틱 회귀(Logistic Regression) (0) | 2022.01.27 |

| 4주차 Day17 Numpy 심화 실습 3 (0) | 2022.01.25 |